CyberSpyder Link Test 3.5.2

CyberSpyder Link Test 3.5.2

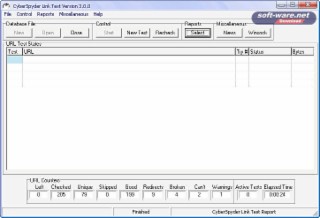

CyberSpyder ist ein Webrobot, der alle HTTP-Links ihrer Webseiten automatisch auf Gültigkeit überprüfen kann

CyberSpyder Link Test ist ein Webrobot, der alle HTTP-Links ihrer Webseiten auf Gültigkeit überprüft. Sie geben lediglich die URL ihrer Homepage vor. CyberSpyder lädt die HTML-Datei und filtert alle Links und Verweise auf ander Dateien, wie bsw. Graphiken heraus.Das Programm forder für alle Verweise die HTTP-Header vom Server an, um aus dem Antwort-Header zu ermitteln, ob die Datei vorhanden ist. Trifft CyberSpyder auf einen Link zu einer HTML-Datei, so wird auch diese heruntergeladen und deren Verweise gefiltert usw. Links zu anderen Domains als der angegebenen Homepage werden nur bis zur ersten Ebene verfolgt.

Nachdem alle Links überprüft wurden zeigt ihnen CyberSpyder einen Report in ihrem Webbrowser an, der ihnen alle aufgetretenen Fehler und deren HTTP-Fehlercode anzeigt. Als besondere Features erlaubt der Robot die Anmeldung mit Passwort auf geschützten Seiten, das Übergehen der Robot-Exclusions und das checken von CGI-Links.

Leider kann CyberSpyder nur HTTP-Links checken. Verweise zu FTP-, Gropher-, Mailservern oder zu lokalen Dateien können nicht überprüft werden.

Download - Verfügbare Versionen

| setupCyberSpyder1.exe |  |

Ähnliche Downloads

Analog ist ein Tool zur Logfile Analyse und Besucherstatistik von Webseiten. Analog besitzt keine grafische Benutzeroberfläche sondern analysiert die Server-Log-Dateien und erzeugt daraus einen umfangreichen Report im HTML-Format mit zahlreichen Auswertungen.

BIND ist der Standard unter den DNS-Servern und auch in einer Version für Windows verfügbar. BIND stellt einen lokalen oder internetweiten Domain Name Service zur Auflösung von Domainnamen oder Reverse-DNS zur Verfügung.

Der Xenu Linkchecker überprüft in sekundenschnelle alle Links und Verknüpfungen einer Webseite. Er kann allen verknüpften Webseiten folgen und auch deren Links checken. Fehlerhafte Links werden ihnen in einem Report angezeigt.

Web-Logfile Analyse-Tool, das auf die Auswertung von Dateidownloads (Software, Videos, Audio, Grafiken) spezialisiert ist. Zudem können Suchbegriffe, Referer ausgewertet und die optimalen Schlüsselbegriffe für ihre Webseiten ermittelt werden.

CanGooRank zeigt ihnen den Google PageRank für eine Webseite / URL. Dabei können sie direkt eine ganze Liste von Webseiten vorgeben und CanGooRank prüft alle in einem Durchgang. So führen sie leicht Statistiken über die Bewertung ihrer Webseiten.